Privacy, RGPD et mesure d'audience

Guides et analyses sur la conformité RGPD, l'analytics frugal, la mesure SEO et le suivi d'audience pour les sites web.

- 02 Mar, 2026

Session Replay (Hotjar, Clarity) : la CNIL ouvre la boîte de Pandore

Vous utilisez peut-être Hotjar, Microsoft Clarity ou Fullstory pour comprendre comment vos visiteurs naviguent sur votre site. Ces outils de « session replay » vous montrent leurs clics, leurs mouvements de souris, leurs hésitations. C'est pratique pour corriger des bugs ou améliorer l'expérience utilisateur. Le problème ? Vous enregistrez peut-être bien plus que ce que vous croyez. Et la CNIL vient de mettre le sujet sur la table. Le 25 février 2026, l'autorité française de protection des données a ouvert une consultation publique sur les outils de session replay. Une première en Europe. La consultation court jusqu'au 22 avril 2026, et la recommandation finale sera adoptée ensuite. Pour les éditeurs de sites web, les agences et les fournisseurs de ces solutions, c'est un signal clair : la récréation est terminée. Les chiffres parlent d'eux-mêmes. En 2025, la CNIL a prononcé 487 millions d'euros d'amendes, dont 21 sanctions spécifiquement liées aux cookies et traceurs. Google a écopé de 325 millions d'euros, Shein de 150 millions. Le session replay, bien plus intrusif qu'un simple cookie de mesure d'audience, est désormais dans le viseur. Cette consultation n'est pas un exercice théorique : c'est le prélude à des contrôles et potentiellement à des sanctions. Dans cet article, vous allez comprendre ce qu'est réellement le session replay, pourquoi c'est plus risqué qu'un outil d'analytics classique, ce que dit la CNIL dans son projet de recommandation, et comment vous mettre en conformité avant que le texte ne devienne contraignant. Parce qu'attendre la version finale pour agir, c'est prendre le risque de devoir tout refaire dans l'urgence. Qu'est-ce que le session replay et pourquoi c'est différent de Google Analytics La différence entre mesure d'audience et enregistrement intégral Quand vous installez Google Analytics, Matomo ou un outil d'analytics frugal, vous collectez des métriques agrégées : nombre de visites, pages vues, taux de rebond, sources de trafic. Vous savez que 1 000 personnes ont visité votre page produit, mais vous ne voyez pas comment chaque personne a navigué, pixel par pixel. Le session replay, c'est tout le contraire. Il enregistre l'intégralité du parcours de navigation d'un utilisateur, comme si vous filmiez son écran. Mouvements de souris, clics, défilements, interactions tactiles sur mobile, et parfois même les saisies dans les formulaires. Ces données sont ensuite rejouées sous forme de vidéo. Vous voyez l'utilisateur hésiter, revenir en arrière, cliquer trois fois sur un bouton qui ne fonctionne pas. C'est extrêmement utile pour identifier des bugs invisibles dans les statistiques classiques. Un formulaire qui plante sur Safari iOS 14, un bouton de paiement mal positionné, un message d'erreur incompréhensible : tout devient visible. Mais cette granularité a un prix : vous collectez des données personnelles à un niveau de détail bien supérieur à ce que permet un outil d'analytics standard. Ce que ces outils enregistrent vraiment La plupart des solutions de session replay capturent par défaut :Les mouvements et positions du curseur (ou du doigt sur mobile). Tous les clics et double-clics. Le défilement des pages (scroll). Les « rage clicks » (clics répétés au même endroit, signe d'irritation). Les survols prolongés sur certains éléments. Les changements d'onglets ou de fenêtres (parfois). Les saisies dans les formulaires, sauf si explicitement masquées.Ce dernier point est critique. Par défaut, certains outils enregistrent ce que les utilisateurs tapent dans les champs de formulaire. Nom, prénom, email, adresse, numéro de téléphone, et même des données sensibles comme les coordonnées bancaires ou les informations de santé si votre site en collecte. La plupart des solutions proposent un masquage automatique, mais encore faut-il l'activer correctement. Résultat : vous pouvez vous retrouver avec des enregistrements qui montrent un utilisateur en train de remplir un formulaire médical, de corriger une faute de frappe dans son numéro de carte bleue, ou de supprimer et réécrire un message dans un champ « motif de résiliation ». Vous voyez le problème ? Les outils concernés Les trois leaders du marché sont :Hotjar : la solution la plus connue des PME et agences. Interface simple, heatmaps intégrées, gratuit jusqu'à 35 sessions/jour. Microsoft Clarity : entièrement gratuit, intégration facile avec Azure et Google Tag Manager, très utilisé depuis 2023. Fullstory : orienté entreprise, avec analyse automatique des comportements et détection d'anomalies par IA.Mais il en existe des dizaines d'autres : Lucky Orange, Smartlook, Mouseflow, SessionCam, Inspectlet, etc. La CNIL ne cible pas une solution en particulier : elle encadre toute la catégorie d'outils. Ce que dit la CNIL dans son projet de recommandation Les usages acceptables selon l'autorité La CNIL ne dit pas que le session replay doit être interdit. Elle fixe un cadre strict. Selon le projet de recommandation publié le 25 février 2026, trois usages sont considérés comme légitimes :Détection et compréhension des erreurs techniques : identifier des bugs, des plantages, des formulaires cassés, des éléments qui ne s'affichent pas correctement sur certains navigateurs ou appareils.Amélioration de l'expérience utilisateur (UX) : repérer des points de friction, des parcours confus, des éléments mal placés. Par exemple, constater que 80 % des utilisateurs cliquent trois fois sur un bouton « Valider » avant de comprendre qu'il faut d'abord cocher une case.Assistance client et support : rejouer la session d'un utilisateur qui rencontre un problème pour mieux comprendre son cas et l'aider à le résoudre.Ces trois usages ont un point commun : ils sont techniques ou orientés support. Ce ne sont pas des usages marketing. Ce qui est exclu : marketing et retargeting La CNIL est très claire sur ce point. Le session replay ne doit pas être utilisé pour :Du retargeting publicitaire (afficher des pubs ciblées à un utilisateur qui a hésité sur une page produit). De la segmentation marketing avancée (créer des audiences selon leur comportement fin). De l'optimisation commerciale agressive (identifier les « acheteurs hésitants » pour leur envoyer une promo).Pourquoi cette exclusion ? Parce que ces usages violent le principe de minimisation des données. Si votre objectif est de vendre, vous n'avez pas besoin de voir chaque mouvement de souris. Des statistiques agrégées suffisent. Le session replay est disproportionné pour ces finalités. Si vous utilisez Hotjar ou Clarity pour « mieux comprendre vos clients » dans une logique de conversion marketing, vous êtes hors-cadre. Et en cas de contrôle CNIL, ça passera mal. Consentement obligatoire : pas d'exemption possible Le projet de recommandation est sans ambiguïté : le session replay nécessite un consentement préalable et explicite de l'utilisateur. Il ne peut pas bénéficier de l'exemption de consentement pour la mesure d'audience. Pourquoi ? Parce que l'exemption, encadrée par l'article 82 de la loi Informatique et Libertés, ne concerne que les traceurs strictement nécessaires à la fourniture du service ou exclusivement dédiés à la mesure d'audience dans un cadre très limité. Le session replay ne rentre dans aucune de ces cases. C'est un outil d'analyse comportementale fine, pas une mesure statistique anonymisée. Concrètement, cela signifie :Vous devez afficher une bannière de consentement (via une CMP, plateforme de gestion du consentement). Le session replay doit apparaître comme un choix distinct dans la bannière, avec une description claire. L'utilisateur doit pouvoir refuser sans que cela n'affecte l'accès au site. Si l'utilisateur refuse ou retire son consentement, les enregistrements doivent cesser immédiatement et les données déjà collectées doivent être supprimées (ou anonymisées de manière irréversible).Minimisation et masquage : des exigences techniques précises La CNIL insiste sur le principe de minimisation. Vous ne devez collecter que ce qui est strictement nécessaire à votre objectif. En pratique, cela implique :Masquage automatique de tous les champs de formulaire sensibles : mots de passe, coordonnées bancaires, données de santé, numéros de sécurité sociale, etc. Masquage par défaut des champs de saisie, sauf si vous pouvez justifier que l'enregistrement est indispensable (par exemple, pour reproduire un bug qui ne se produit que sur une saisie spécifique). Échantillonnage : enregistrer seulement un pourcentage des sessions, pas 100 %. Si vous avez 10 000 visites par jour, enregistrer les 10 000 sessions est disproportionné. Échantillonner 5 % ou 10 % suffit largement pour identifier des bugs. Durée de conservation courte : les sessions doivent être supprimées dès que l'objectif est atteint. Une session enregistrée pour corriger un bug n'a pas vocation à être conservée 12 mois « au cas où ».La CNIL recommande également de documenter vos paramétrages. En cas de contrôle, il faudra prouver que vous avez activé les masquages, configuré l'échantillonnage et limité la durée de conservation. Responsabilités : qui doit faire quoi ? Fournisseur vs éditeur de site La recommandation CNIL distingue deux acteurs :Le fournisseur de la solution (Hotjar, Microsoft, Fullstory, etc.) : il conçoit l'outil, définit les paramétrages par défaut, propose (ou non) des options de masquage et de minimisation. Il peut être considéré comme responsable de traitement pour ses propres usages (améliorer son produit, par exemple) ou comme sous-traitant s'il ne fait qu'héberger les données pour le compte de l'éditeur du site.L'éditeur du site web ou de l'application mobile : c'est vous, si vous installez Hotjar sur votre site. Vous êtes responsable de traitement pour l'usage que vous faites du session replay. C'est à vous de recueillir le consentement, de configurer le masquage, de définir les durées de conservation.Dans certains cas, la CNIL évoque une responsabilité conjointe (article 26 du RGPD) : si le fournisseur et l'éditeur poursuivent des finalités communes (par exemple, si Hotjar utilise vos données pour améliorer son algorithme de détection d'anomalies), ils doivent signer un accord de co-responsabilité. Agences web : attention au piège contractuel Si vous êtes une agence web et que vous installez Hotjar ou Clarity pour vos clients, la question de la responsabilité se complique. Qui doit recueillir le consentement ? Qui configure le masquage ? Qui est sanctionné en cas de manquement ? Par défaut, c'est le client (l'éditeur du site) qui reste responsable. Mais si vous ne l'avez pas informé des obligations, si vous n'avez pas configuré correctement l'outil, ou si vous n'avez pas documenté les paramétrages, vous pouvez être mis en cause. La CNIL a déjà sanctionné des prestataires techniques pour non-respect de leurs obligations en tant que sous-traitants. Notre conseil : ajoutez dès maintenant une clause dans vos contrats qui précise :Qui est responsable de la conformité RGPD du session replay. Qui configure les masquages et l'échantillonnage. Qui met à jour la bannière de consentement. Qui conserve la documentation de conformité.Et facturez la mise en conformité. Ce n'est pas inclus dans un forfait « installation de Hotjar ». Les alternatives et bonnes pratiques pour rester conforme Option 1 : Configurer strictement le session replay Si vous voulez continuer à utiliser Hotjar, Clarity ou équivalent, voici les étapes :Activez le masquage automatique de tous les champs de formulaire. La plupart des outils proposent un mode « strict » qui masque tout par défaut.Réduisez l'échantillonnage à 5-10 % des sessions. Vous n'avez pas besoin d'enregistrer 100 % du trafic pour détecter des bugs.Limitez la durée de conservation à 30 jours maximum. Si vous n'avez pas corrigé le bug en 30 jours, c'est que ce n'était pas urgent.Mettez à jour votre CMP (OneTrust, Axeptio, Cookiebot, Didomi, etc.) pour ajouter une case spécifique « Analyse comportementale » ou « Session replay », distincte de la case « Mesure d'audience ».Documentez tout : captures d'écran des paramètres, fichier Excel listant les champs masqués, justification de la finalité.Option 2 : Remplacer par des heatmaps ou des analytics frugaux Le session replay est souvent utilisé pour des besoins qui ne nécessitent pas un enregistrement intégral. Quelques alternatives :Heatmaps (cartes de chaleur) : elles montrent où les utilisateurs cliquent le plus, sans enregistrer le parcours individuel. C'est beaucoup moins intrusif. Analytics orientée événements : configurez des événements spécifiques dans Google Analytics, Matomo ou un outil frugal pour mesurer les clics sur certains boutons, les erreurs de formulaire, les abandons de panier. A/B testing : testez deux versions d'une page plutôt que de chercher à « comprendre » pourquoi la version actuelle ne fonctionne pas.Ces approches vous donnent 80 % de l'information utile, avec 10 % du risque juridique. Option 3 : Session replay strictement sur demande utilisateur Une pratique émergente consiste à n'activer le session replay que lorsque l'utilisateur le demande explicitement. Par exemple :Un utilisateur contacte le support en disant « j'ai un problème avec le formulaire ». Le support lui envoie un lien unique qui active temporairement l'enregistrement de sa session, avec son consentement explicite. La session est enregistrée, analysée, puis supprimée immédiatement après résolution du problème.C'est la méthode la plus conforme, mais elle nécessite une infrastructure technique un peu plus complexe. Ce qui va se passer après la consultation Calendrier et prochaines étapes La consultation publique se termine le 22 avril 2026. Ensuite, la CNIL va :Analyser les contributions reçues (professionnels, fédérations, associations de consommateurs, ONG). Réviser le projet de recommandation si nécessaire. Adopter la version finale, probablement au cours du second semestre 2026. Publier la recommandation sur son site, avec une période de transition (généralement 6 à 12 mois).Pendant la période de transition, la CNIL ne sanctionnera pas immédiatement, mais elle attend une mise en conformité progressive. Passé ce délai, les contrôles commenceront. Risques en cas de non-conformité Si vous continuez à utiliser le session replay sans consentement ou avec des paramétrages non conformes, vous vous exposez à :Une mise en demeure de la CNIL (première étape, publique ou non). Une sanction pécuniaire pouvant aller jusqu'à 20 millions d'euros ou 4 % du chiffre d'affaires mondial (article 83 du RGPD). Une publicité de la sanction, avec impact réputationnel.En 2025, 67 sanctions sur 83 ont été prononcées via la procédure simplifiée, avec des amendes plafonnées à 20 000 euros pour les « petits » manquements. Mais pour les cas graves (collecte massive, absence totale de consentement, données sensibles exposées), les montants peuvent être bien plus élevés. Shein a pris 150 millions d'euros pour des cookies, et le session replay est objectivement plus intrusif qu'un cookie. Effet domino en Europe La France n'est pas seule. D'autres autorités européennes surveillent ce dossier de près. Si la CNIL adopte une recommandation stricte, il est probable que :L'EDPB (Comité européen de la protection des données) s'en inspire pour un avis ou des lignes directrices au niveau européen. Les autorités allemande (DSB), italienne (Garante), espagnole (AEPD) ou irlandaise (DPC) suivent avec leurs propres textes.Autrement dit, si vous opérez en Europe, respecter les règles CNIL sera de toute façon nécessaire à court terme, même si vous n'avez pas de trafic français. Conclusion : agir maintenant, pas en avril 2027 La consultation CNIL sur le session replay est un signal d'alerte, pas une surprise. Les outils qui enregistrent l'intégralité des parcours utilisateurs sont dans le viseur des régulateurs depuis plusieurs années. Ce qui change en 2026, c'est que la CNIL passe de la sensibilisation à l'encadrement formel. Si vous utilisez Hotjar, Clarity ou tout autre outil de session replay, vous avez deux options. Soit vous configurez strictement l'outil dès maintenant : masquage, échantillonnage, consentement, documentation. Soit vous envisagez des alternatives moins intrusives : heatmaps, analytics frugaux, tests A/B. L'inaction n'est plus une stratégie viable. Les PME et les agences web ont jusqu'à fin 2026 pour se mettre en conformité sans risque immédiat. Mais plus vous attendez, plus la mise en conformité sera coûteuse et précipitée. Et vu les montants d'amendes prononcés en 2025 (487 millions d'euros au total), le risque n'est plus théorique. Pour ceux qui cherchent une approche plus simple, il existe des solutions de mesure d'audience qui respectent par conception les principes de minimisation et de transparence. Si cette démarche vous parle, vous pouvez rejoindre la liste d'attente de Pomelo pour être informé du lancement. FAQ Est-ce que je peux continuer à utiliser Hotjar ou Clarity après la recommandation CNIL ? Oui, à condition de respecter les exigences : recueillir le consentement explicite via une bannière CMP, activer le masquage de tous les champs sensibles, limiter l'échantillonnage (5-10 % des sessions maximum), réduire la durée de conservation à 30 jours, et documenter tous vos paramétrages. Si vous remplissez ces conditions, vous pouvez continuer à utiliser ces outils pour des finalités techniques (détection de bugs, amélioration UX, support client). En revanche, les usages marketing (retargeting, segmentation avancée) sont exclus. Le session replay est-il concerné par l'exemption de consentement pour la mesure d'audience ? Non. L'exemption de consentement prévue à l'article 82 de la loi Informatique et Libertés ne s'applique qu'aux outils de mesure d'audience strictement limités à des statistiques agrégées et anonymes. Le session replay, qui enregistre des parcours individuels détaillés, ne peut pas en bénéficier. Vous devez donc obligatoirement recueillir le consentement des utilisateurs avant d'activer l'enregistrement, même si votre objectif est purement technique. Si je suis une agence web, qui est responsable de la conformité : moi ou mon client ? Par défaut, c'est l'éditeur du site (votre client) qui est responsable de traitement pour les données collectées via le session replay. Mais vous, en tant qu'agence, êtes responsable en tant que sous-traitant de la bonne configuration technique de l'outil. Si vous installez Hotjar sans activer le masquage, sans configurer l'échantillonnage, ou sans ajouter une case dans la bannière de consentement, vous pouvez être mis en cause. Il est donc essentiel de clarifier cette répartition des responsabilités dans un contrat écrit et de facturer la mise en conformité RGPD comme une prestation distincte. Quelles sont les sanctions prévues si je n'applique pas la recommandation CNIL ? La recommandation CNIL n'a pas force de loi, mais elle précise comment appliquer le RGPD et la loi Informatique et Libertés. Ne pas la respecter expose à une mise en demeure, puis à une sanction pécuniaire pouvant atteindre 20 millions d'euros ou 4 % du chiffre d'affaires mondial, selon l'article 83 du RGPD. En pratique, pour les PME, les amendes via la procédure simplifiée sont plafonnées à 20 000 euros pour les manquements moins graves. Mais en cas de collecte massive sans consentement ou de données sensibles exposées, les montants peuvent être bien plus élevés, comme l'illustrent les sanctions de 2025 (Google 325 M€, Shein 150 M€). Existe-t-il des alternatives moins risquées au session replay pour améliorer l'UX ? Oui, plusieurs alternatives permettent d'obtenir des insights UX sans enregistrer des parcours individuels complets. Les heatmaps (cartes de chaleur) montrent les zones les plus cliquées sans identifier les utilisateurs. Les analytics orientées événements permettent de mesurer des actions spécifiques (clics sur un bouton, erreurs de formulaire) avec des outils comme Google Analytics, Matomo ou des solutions frugales. Les tests A/B comparent deux versions d'une page pour identifier la plus performante. Enfin, les enquêtes utilisateurs (post-achat ou exit-intent) donnent des retours qualitatifs directs. Ces approches fournissent 80 % de l'information utile avec beaucoup moins de risques juridiques. SourcesCNIL, "Rejeu de session : la CNIL lance une consultation publique sur son projet de recommandation", 25 février 2026 (https://www.cnil.fr/fr/rejeu-de-session-la-cnil-lance-une-consultation-publique-sur-son-projet-de-recommandation) CNIL, "Sanctions et mesures correctrices : la CNIL présente le bilan 2025", 9 février 2026 (https://www.cnil.fr/fr/thematique/cnil/sanctions) CNIL, "Cookies et publicités insérées entre les courriels : la CNIL sanctionne GOOGLE d'une amende de 325 millions d'euros", 1er septembre 2025 (https://www.cnil.fr/en/cookies-and-advertisements-inserted-between-emails-google-fined-325-million-euros-cnil) Nomos, "Session replay: the CNIL's draft recommendation", 27 février 2026 (https://www.nomosparis.com/en/session-replay-the-cnils-draft-recommendation/) PPC Land, "France's CNIL puts session replay tools under the privacy microscope", 26 février 2026 (https://ppc.land/frances-cnil-puts-session-replay-tools-under-the-privacy-microscope/) Solutions Numériques, "Rejeu de session : la CNIL ouvre une consultation publique pour encadrer ces outils de suivi", 25 février 2026 (https://www.solutions-numeriques.com/rejeu-de-session-la-cnil-ouvre-une-consultation-publique-pour-encadrer-ces-outils-de-suivi/) August Debouzy, "Cookies et autres traceurs, une action de régulation ciblée au niveau national", février 2026 (https://www.august-debouzy.com/fr/blog/2281-cookies-et-autres-traceurs-une-action-de-regulation-ciblee-au-niveau-national)

Lire l'article →

- 28 Feb, 2026

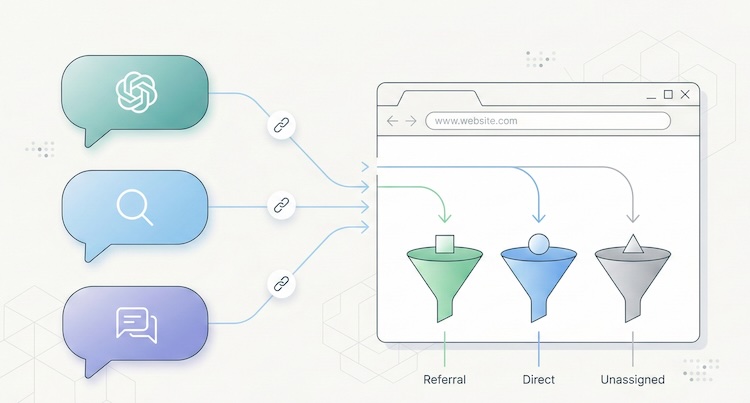

Trafic IA : comment mesurer les visites que ChatGPT, Perplexity et Claude envoient sur votre site

Quelque chose a changé dans la manière dont les internautes découvrent votre site. Et il y a de fortes chances que vous ne le voyiez pas. Depuis fin 2024, les plateformes d'intelligence artificielle conversationnelle ne se contentent plus de répondre aux questions de leurs utilisateurs. Elles citent des sources, insèrent des liens, et envoient des visiteurs réels vers des sites web. ChatGPT, Perplexity, Claude, Gemini, Copilot : ces outils sont en train de devenir un canal de découverte à part entière, comparable aux moteurs de recherche classiques par la qualité du trafic qu'ils génèrent. Le problème ? La plupart des outils analytics ne distinguent pas ce trafic. Il se noie dans la catégorie "referral", se mélange au "direct", ou disparaît purement et simplement des rapports. Résultat : vous avez peut-être déjà des visiteurs qui arrivent via une recommandation de ChatGPT, et vous ne le savez pas. Cet article vous donne la méthode complète pour identifier ce trafic, comprendre sa valeur, et adapter votre stratégie de contenu. Un nouveau canal de découverte en pleine explosion Les chiffres sont encore modestes en volume absolu, mais la dynamique est spectaculaire. Selon une étude de SE Ranking portant sur près de 64 000 sites dans 250 pays (janvier-avril 2025), ChatGPT concentre à lui seul 78 % du trafic IA référent mondial. Perplexity représente environ 15 %, Gemini 6,4 %. Claude et DeepSeek se partagent le reste, avec des parts inférieures à 1 % mais des dynamiques de croissance très intéressantes. (Source : SE Ranking, "AI Traffic in 2025") Une analyse complémentaire de Conductor, relayée par Search Engine Land, confirme cette hiérarchie sur un échantillon de 13 770 domaines et 3,3 milliards de sessions : le trafic IA représente en moyenne 1 % du trafic total d'un site, et ChatGPT en génère 87 % à lui seul. (Source : Search Engine Land, nov. 2025) Un pour cent, c'est peu en apparence. Mais deux éléments changent la perspective. La croissance est fulgurante. Entre janvier et avril 2025, la part de ChatGPT dans le trafic internet global a doublé, passant de 0,08 % à 0,16 %. La progression annuelle du trafic IA référent dépasse les 500 % sur certains segments. Et Gartner prévoit une baisse de 25 % du volume de recherche traditionnelle d'ici fin 2026, au profit des agents conversationnels. La qualité du trafic est supérieure. Les visiteurs provenant des plateformes IA passent en moyenne 9 à 10 minutes par session sur les sites visités, contre 3 à 4 minutes pour le trafic organique classique. Selon SE Ranking, les sessions référées par Claude atteignent même une durée moyenne de 67 minutes dans l'UE, un chiffre hors norme qui suggère un engagement exceptionnel. Le taux de conversion du trafic IA serait 1,5 fois supérieur à celui du trafic social, selon les données agrégées de plusieurs études sectorielles. L'explication est logique : un utilisateur qui clique sur un lien dans une réponse IA a déjà formulé une question précise, reçu un contexte, et choisi de visiter votre site parmi les sources citées. Son intention est pré-qualifiée. C'est un visiteur qui sait pourquoi il vient. Pourquoi vos analytics ne voient pas ce trafic Si le trafic IA est si intéressant, pourquoi n'apparaît-il pas clairement dans vos rapports ? Trois raisons techniques expliquent cet angle mort. Le problème du referrer manquant Lorsqu'un utilisateur clique un lien dans Perplexity depuis un navigateur web, le header HTTP Referer transmet généralement perplexity.ai comme source. L'outil analytics peut alors classer cette visite en "referral" depuis Perplexity. Mais ce mécanisme ne fonctionne pas toujours. Selon une étude de SparkToro, 60 % des sessions provenant d'outils IA n'ont pas de header referrer exploitable. Les raisons sont multiples : les applications mobiles (ChatGPT sur iOS, Copilot dans Windows) ouvrent les liens dans des webviews internes qui ne transmettent pas de referrer. Les fonctions de pré-chargement ("prefetch") de certains agents IA consultent la page sans déclencher le script analytics. Et le navigateur intégré de ChatGPT Atlas, lancé fin 2025, se comporte différemment des navigateurs classiques. (Source : MarTech, nov. 2025) Résultat : une part importante du trafic IA tombe dans la catégorie "direct" ou "unassigned" de vos analytics, invisible et non attribué. La classification par défaut de GA4 Google Analytics 4 classe le trafic IA comme "referral", au même titre qu'un lien depuis Facebook, un forum, ou un annuaire. Il n'existe pas (encore) de canal dédié "AI" dans la configuration par défaut de GA4. Google a annoncé son intention d'en créer un, mais la mise en place n'a pas encore eu lieu. Concrètement, si vous ouvrez votre rapport d'acquisition dans GA4 sans configuration spécifique, le trafic de ChatGPT est noyé parmi des dizaines d'autres sources de referral. Pour un site qui reçoit des centaines de referrers différents, repérer chatgpt.com ou perplexity.ai demande de savoir ce qu'on cherche. La confusion bots vs humains Les plateformes IA ont deux manières d'interagir avec votre site. La première est le trafic référent : un humain clique sur un lien dans une réponse IA et arrive sur votre page. C'est du vrai trafic, avec un vrai visiteur. La seconde est le crawl : les robots des plateformes IA (GPTBot pour OpenAI, PerplexityBot, ClaudeBot, etc.) visitent votre site pour indexer son contenu et nourrir leurs modèles. Ce crawl n'est pas du trafic utile, c'est de l'aspiration de données. GA4 filtre automatiquement les bots connus, mais la liste n'est pas exhaustive. Certains bots IA récents passent entre les mailles du filet, ou au contraire, certains visiteurs humains légitimes provenant d'outils IA sont filtrés par erreur. Selon Cloudflare, le ratio de crawl par rapport aux clics référents peut atteindre 700:1 pour Perplexity, ce qui donne une idée de l'ampleur du phénomène d'aspiration. (Source : Digiday, déc. 2025) Méthode : identifier le trafic IA dans vos outils Deux approches sont possibles selon l'outil que vous utilisez. Dans GA4 : créer un canal "Trafic IA" dédié La méthode recommandée consiste à créer un channel group personnalisé qui regroupe toutes les sources IA connues. Voici la procédure :Dans GA4, allez dans Admin > Paramètres des données > Groupes de canaux. Cliquez sur le groupe de canaux par défaut, puis "Copier" pour en créer un nouveau. Ajoutez un canal nommé "Trafic IA" (ou "AI Traffic"). Définissez la règle : Type de correspondance = "correspond à l'expression régulière", puis collez cette regex :(chatgpt\.com|chat\.openai\.com|perplexity\.ai|claude\.ai|gemini\.google\.com|copilot\.microsoft\.com|deepseek\.com|meta\.ai)Placez ce canal au-dessus du canal "Referral" par défaut dans l'ordre de priorité. C'est crucial : GA4 évalue les règles de haut en bas, et si "Trafic IA" est en dessous de "Referral", les visites seront classées en referral avant d'atteindre votre règle.Cette configuration ne s'applique qu'aux nouvelles données (pas de rétroactivité). Comptez quelques jours avant de voir les premiers résultats. Pour une analyse ponctuelle sur des données existantes, vous pouvez créer un rapport Exploration avec un filtre sur la dimension "Source de la session" utilisant la même regex. (Source : MarTech, nov. 2025) Dans un analytics frugal (Plausible, Fathom, etc.) C'est ici que la simplicité d'un outil bien conçu fait toute la différence. Dans Plausible, par exemple, le rapport "Sources" affiche directement chaque referrer identifié. Si chatgpt.com ou perplexity.ai apparaît comme source, vous le voyez immédiatement, sans configuration, sans regex, sans channel group. Il suffit de cliquer sur la source pour filtrer l'ensemble du dashboard par cette provenance et analyser les pages d'entrée, le temps passé, et les événements déclenchés. Plausible a d'ailleurs documenté sa propre expérience : en 2024, le blog de Plausible a constaté une hausse de 2 200 % de son trafic IA référent en quelques mois, identifiable directement depuis leur dashboard standard. (Source : Plausible, déc. 2024) C'est un cas d'école où la philosophie de l'analytics frugale paie : quand l'outil est conçu pour montrer les données essentielles sans couches de configuration, les signaux émergents deviennent visibles immédiatement. Un outil comme GA4, qui noie ses utilisateurs dans des centaines de dimensions et nécessite une expertise technique pour chaque nouvelle source de trafic, crée un retard systématique dans la détection des tendances. Pour une comparaison détaillée des capacités de tracking de ces outils, consultez notre comparatif Plausible vs Fathom vs Simple Analytics. Trafic IA vs crawl IA : deux phénomènes distincts Une confusion fréquente consiste à mélanger le trafic référent (des humains qui cliquent) et le crawl (des robots qui aspirent). Il est important de les distinguer, car ils posent des questions différentes. Le trafic référent IA est une opportunité. C'est un visiteur qualifié, pré-informé, qui arrive avec une intention. Le mesurer permet d'optimiser les pages d'entrée, d'adapter le contenu, et de comprendre comment les IA perçoivent votre site. Le crawl IA est une question de gouvernance. Les robots comme GPTBot, PerplexityBot ou ClaudeBot visitent votre site pour entraîner leurs modèles ou répondre en temps réel aux requêtes de leurs utilisateurs. Certains le font de manière intensive : Cloudflare a observé que le volume de crawl de GoogleBot (qui alimente aussi Gemini) dépasse de loin celui de tous les autres bots IA combinés. Vous pouvez contrôler le crawl via votre fichier robots.txt : User-agent: GPTBot Disallow: /User-agent: PerplexityBot Disallow: /User-agent: ClaudeBot Disallow: /Mais attention au paradoxe : bloquer le crawl peut réduire votre trafic référent. Si une IA ne peut pas indexer votre contenu, elle ne pourra pas le recommander à ses utilisateurs. C'est un arbitrage à faire en connaissance de cause. Une approche émergente consiste à utiliser un fichier llms.txt (au format Markdown, placé à la racine du site) pour guider les IA vers le contenu que vous souhaitez rendre accessible, sans bloquer l'ensemble du crawl. Anthropic (le créateur de Claude) utilise d'ailleurs ce mécanisme sur son propre site. Comment être cité par les IA Comprendre le trafic IA, c'est aussi comprendre ce qui le déclenche. Les plateformes d'IA ne citent pas les sites au hasard. Plusieurs facteurs favorisent les citations. La structure du contenu compte. Les pages organisées avec une hiérarchie claire (H2, H3, listes) et qui répondent directement à des questions précises ont 40 % de chances supplémentaires d'être citées, selon les analyses de Superprompt. Les FAQ structurées sont particulièrement efficaces : elles correspondent exactement au format question-réponse des interactions IA. La fraîcheur est un signal fort. Contrairement à Google, qui favorise les contenus établis et anciens, les IA privilégient les contenus récemment mis à jour. Les pages actualisées dans les 30 derniers jours obtiennent en moyenne 3 fois plus de citations IA. Les données originales attirent les citations. Les tableaux de données, les statistiques propres, les benchmarks exclusifs sont 4 fois plus cités que le contenu généraliste. C'est un argument supplémentaire pour l'approche data-driven et les KPIs précis plutôt que les métriques de vanité. Le SEO classique reste la fondation. Selon plusieurs études convergentes, 77 % de l'optimisation pour les IA découle directement d'un bon référencement traditionnel. Les sites qui apparaissent dans le top 10 de Google ont significativement plus de chances d'être cités par les LLM. Le SEO ne dépend pas de Google Analytics, mais il reste le socle sur lequel se construit la visibilité IA. Ce que ça change pour le choix de votre outil analytics Le trafic IA met en lumière une faiblesse structurelle des outils analytics complexes : leur incapacité à rendre visible un signal émergent sans configuration préalable. Avec GA4, il faut créer un channel group, écrire une regex, la mettre à jour régulièrement (de nouveaux outils IA apparaissent chaque mois), et accepter que les données ne seront pas rétroactives. C'est faisable, mais ça demande une compétence technique que la plupart des dirigeants de PME ou des freelances n'ont pas. Avec un analytics frugal bien conçu, les referrers IA apparaissent naturellement dans le rapport des sources, au même titre que Google, LinkedIn ou Twitter. Pas de configuration, pas de regex, pas d'angle mort. C'est le principe même de la sobriété analytique : collecter moins de données, mais rendre chaque donnée immédiatement lisible. Le trafic IA n'est pas un phénomène passager. C'est le début d'un changement structurel dans la manière dont les internautes découvrent du contenu. Les sites qui le mesurent aujourd'hui auront un avantage concurrentiel demain, non pas parce que le volume est énorme, mais parce que la qualité de ce trafic en fait un levier de conversion puissant. La question n'est plus de savoir si les IA envoient du trafic vers votre site. C'est de savoir si votre outil de mesure vous le montre.Questions fréquentes Quelle part de mon trafic provient des IA ? En moyenne, environ 1 % du trafic total d'un site provient des plateformes IA (ChatGPT, Perplexity, Gemini, etc.), selon l'étude Conductor de novembre 2025 portant sur 13 770 domaines. Ce chiffre peut être plus élevé pour les sites à faible trafic ou les sites de niche B2B. Mais surtout, ce 1 % ne reflète que le trafic identifiable : selon SparkToro, 60 % des sessions IA n'ont pas de referrer et tombent donc dans la catégorie "direct", ce qui signifie que le trafic réel est probablement 2 à 3 fois supérieur au chiffre affiché. Comment voir le trafic ChatGPT dans Google Analytics 4 ? GA4 ne dispose pas encore d'un canal "IA" natif. Vous devez créer un channel group personnalisé : dans Admin > Paramètres des données > Groupes de canaux, ajoutez un canal "Trafic IA" avec une règle regex couvrant les domaines IA (chatgpt.com, perplexity.ai, claude.ai, gemini.google.com, copilot.microsoft.com). Placez-le au-dessus du canal "Referral" dans la hiérarchie. Les données ne seront collectées qu'à partir de la date de création du canal. Faut-il bloquer les bots IA avec robots.txt ? C'est un arbitrage. Bloquer les bots IA (GPTBot, PerplexityBot, ClaudeBot) via robots.txt empêche l'indexation de votre contenu par ces plateformes, ce qui peut réduire les citations et donc le trafic référent. À l'inverse, ne pas bloquer signifie que votre contenu alimente l'entraînement de modèles IA, ce qui soulève des questions de propriété intellectuelle et de consentement. Une approche intermédiaire consiste à utiliser un fichier llms.txt pour guider les IA vers le contenu que vous souhaitez rendre accessible. Les analytics sans cookies détectent-elles le trafic IA ? Oui, et souvent mieux que GA4. Les outils cookieless comme Plausible, Fathom ou Simple Analytics affichent les referrers IA directement dans leur rapport de sources, sans configuration. L'absence de couches de paramétrage (channel groups, regex, filtres) signifie que les nouvelles sources de trafic sont visibles immédiatement. C'est un avantage structurel de l'approche frugale pour détecter les signaux émergents. Comment optimiser son contenu pour être cité par ChatGPT ou Perplexity ? Cinq leviers principaux : structurer le contenu avec des titres clairs (H2/H3) et des FAQ ; maintenir le contenu à jour (les IA favorisent la fraîcheur) ; produire des données originales (tableaux, statistiques, benchmarks) ; soigner le SEO classique (les sites bien référencés dans Google sont plus cités par les IA) ; et envisager un fichier llms.txt pour faciliter l'accès des IA à votre contenu structuré. Les pages qui répondent directement à des questions précises, dans un format clair, sont celles qui obtiennent le plus de citations.Données vérifiées en février 2026. Les parts de marché du trafic IA évoluent rapidement. Cet article sera mis à jour tous les six mois.

- 07 Feb, 2026

Plausible vs Fathom vs Simple Analytics : le comparatif 2026 des analytics frugales

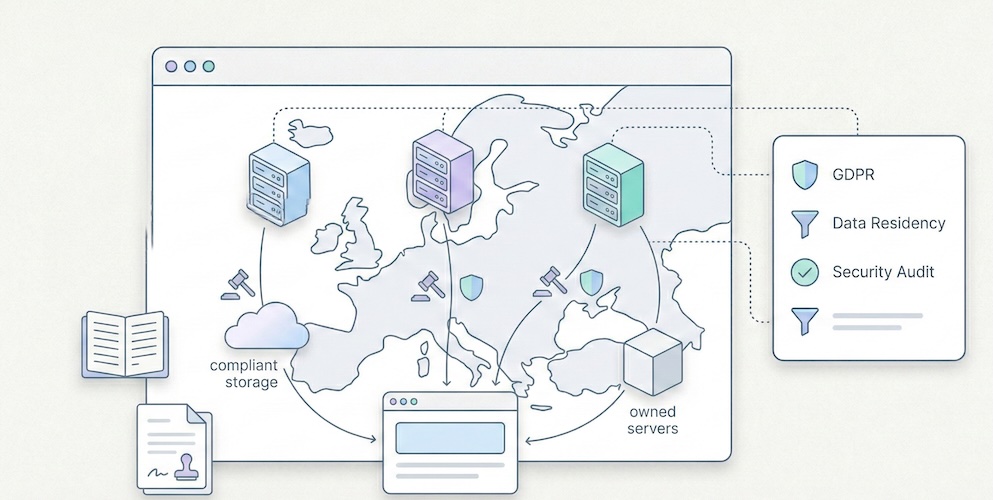

Vous avez décidé de quitter Google Analytics. Vous avez compris que le « gratuit » avait un coût réel, que la complexité de GA4 dépassait vos besoins, et que la conformité RGPD méritait mieux qu'un bandeau cookie mal configuré. Parfait. Vous faites partie d'un mouvement en pleine accélération. Reste le choix le plus difficile : parmi les alternatives privacy-first, laquelle correspond vraiment à votre situation ? Trois noms reviennent systématiquement dans les recommandations : Plausible, Fathom et Simple Analytics. Ce sont les solutions les plus citées, les plus matures et les plus crédibles du segment « analytics frugales ». Mais leurs différences, souvent invisibles dans les présentations marketing, ont des conséquences très concrètes sur votre facture, votre conformité et votre quotidien. Ce comparatif ne vise pas à élire un vainqueur universel. Il cherche à vous donner les éléments factuels pour choisir en connaissance de cause. Nous avons vérifié les prix sur les pages officielles, documenté les fonctionnalités réelles, et ajouté deux outsiders souvent oubliés dans les discussions : Pirsch et Umami. Ce que ces trois solutions ont en commun Avant de détailler les différences, posons le cadre. Plausible, Fathom et Simple Analytics partagent un socle commun qui les distingue radicalement de Google Analytics : Aucune de ces solutions n'utilise de cookies par défaut. Elles ne construisent pas de profil publicitaire. Leur script pèse moins de 5 KB (contre environ 45 KB pour GA4, selon les mesures de HTTP Archive). Elles affichent toutes les métriques essentielles sur une seule page, sans menu imbriqué ni formation préalable. Sur le plan légal, toutes trois revendiquent la conformité RGPD sans bandeau cookie. En pratique, le niveau de cette conformité varie, et c'est l'un des points que nous allons détailler. Enfin, les trois sont des entreprises indépendantes, sans levée de fonds massive, financées par leurs abonnements. C'est un signal fort de pérennité. Les prix réels, comparés poste par poste Le prix d'entrée ne dit pas tout. Ce qui compte, c'est le coût à volume équivalent. Voici les tarifs vérifiés sur les pages officielles de chaque solution en février 2026. Grille de prix mensuelle (en dollars, facturation mensuelle)Volume mensuel Plausible (Starter) Fathom Simple Analytics (Simple)10 000 pageviews 9 $ 15 $ 15 $100 000 pageviews 9 $ (même palier) 15 $ ~19 $200 000 pageviews 14 $ (Growth) 25 $ ~29 $500 000 pageviews ~19 $ (Business) 45 $ ~49 $1 000 000 pageviews sur devis 60 $ sur devisSources : plausible.io/pricing, usefathom.com/pricing, simpleanalytics.com/pricing. Tarifs vérifiés en février 2026. À retenir : Plausible est la solution la moins chère à petit volume (9 $/mois pour 10k pageviews). Mais sa tarification monte rapidement : le plan Growth à 14 $ et le plan Business à 19 $ débloquent des fonctionnalités supplémentaires (plus de sites, accès équipe, funnels). Fathom propose un tarif unique par palier de volume, avec toutes les fonctionnalités incluses dès 15 $/mois. Pas de plan gratuit. Pas de remise. Leur philosophie affichée : un prix identique pour tout le monde, sans promotion. Simple Analytics offre un plan gratuit (limité à 30 jours d'historique) et un plan Simple à 15 $/mois. Le plan Team (40 $/mois) ajoute la collaboration et l'accès API. Leur pricing évolue de manière dynamique : la facture s'ajuste automatiquement selon la moyenne de trafic des trois derniers mois. Deux outsiders à connaître Pirsch (basé en Allemagne) propose l'un des prix d'entrée les plus bas du marché : 6 $/mois pour 10 000 pageviews, 10 $/mois pour 100 000 pageviews. Il inclut le white-label et jusqu'à 50 domaines. Sources : pirsch.io/pricing. Umami est open source et entièrement auto-hébergeable gratuitement. C'est la seule solution du comparatif qui ne coûte rien en licence, à condition de gérer soi-même l'hébergement. Pour ceux qui préfèrent un service géré, Umami Cloud commence à 9 $/mois. Source : umami.is. Hébergement et localisation des données C'est le point critique pour la conformité RGPD. La question n'est pas seulement « où sont les serveurs ? » mais « qui opère l'infrastructure et sous quelle juridiction ? ».Solution Localisation des données Infrastructure Entité juridiquePlausible Union européenne (Hetzner, Allemagne) Propriété d'entreprises européennes Plausible Insights OÜ (Estonie)Fathom Serveurs en Allemagne (via AWS EU) Amazon Web Services Conva Ventures Inc. (Canada)Simple Analytics Pays-Bas Serveurs européens propriétaires Simple Analytics B.V. (Pays-Bas)Pirsch Allemagne Serveurs allemands Emvi Software GmbH (Allemagne)Umami (Cloud) Variable selon le plan Vercel/Cloud Umami Software Inc. (États-Unis)Plausible insiste sur le fait que l'ensemble de son infrastructure est opéré par des entreprises européennes. Début 2026, ils revendiquent plus de 16 000 abonnés payants, dont 600 comptes entreprise. Source : plausible.io/enterprise-web-analytics. Fathom utilise AWS en région européenne (Francfort), mais l'entité juridique est canadienne. Le Canada bénéficie d'une décision d'adéquation de la Commission européenne, ce qui simplifie les transferts. Mais pour les organisations les plus strictes sur la souveraineté des données, ce n'est pas équivalent à une entité 100 % européenne. Simple Analytics est la solution la plus explicite sur la localisation : données exclusivement aux Pays-Bas, serveurs propriétaires, aucun sous-traitant américain. C'est l'argument le plus fort pour les organisations soumises à des politiques de souveraineté strictes. Pirsch, basé et hébergé en Allemagne, offre une alternative comparable en termes de localisation européenne. La question du respect de la vie privée Les trois solutions se revendiquent « privacy-first ». Mais le diable est dans les détails techniques. Plausible utilise un hash de l'adresse IP du visiteur combiné avec le User-Agent et un sel quotidien pour identifier les visiteurs uniques. L'adresse IP brute n'est jamais stockée. Le hash est renouvelé chaque jour, ce qui empêche le suivi à long terme. C'est une forme de pseudonymisation. Fathom emploie une approche similaire de hachage, mais ajoute une couche de routage via ce qu'ils appellent des « signatures uniques ». Comme Plausible, l'IP brute n'est pas conservée. Simple Analytics se distingue en affirmant ne collecter aucune donnée personnelle, y compris sous forme hachée. Pas de hash d'IP, pas de User-Agent enregistré. Leur comptage de visiteurs uniques repose sur un mécanisme différent, basé sur les référents et les URLs. C'est l'approche la plus radicale en matière de minimisation. Cette différence a une conséquence directe : Simple Analytics peut légitimement affirmer ne pas traiter de données personnelles au sens du RGPD, ce qui renforce le cas d'exemption de consentement. Pour Plausible et Fathom, la question est plus nuancée : un hash d'IP, même non réversible, pourrait être considéré comme une donnée pseudonymisée. En pratique, les autorités de protection des données (dont la CNIL) tendent à accepter ces approches si elles respectent les critères d'exemption (pas de recoupement, conservation limitée, finalité strictement statistique). Pour approfondir les conditions d'exemption de consentement, consultez notre article dédié : Mesure d'audience, RGPD et exemption de bandeau cookie. Fonctionnalités : ce que chacun fait (et ne fait pas) Toutes ces solutions ont fait le choix de la simplicité. Mais « simple » ne veut pas dire identique. Voici les différences qui comptent au quotidien. Tableau comparatif des fonctionnalitésFonctionnalité Plausible Fathom Simple AnalyticsDashboard mono-page Oui Oui OuiÉvénements personnalisés Oui Oui OuiObjectifs / Conversions Oui (funnels avancés) Oui OuiFunnels multi-étapes Oui (plan Business) Non NonIntégration Google Search Console Oui Non NonSuivi e-commerce (revenus) Oui (plan Business) Oui NonImport données GA4 Oui Oui NonAPI d'export Oui Oui Oui (plan Team)Rapports par email Oui Oui OuiPartage de dashboard Oui (lien public/privé) Oui (lien partageable) OuiMulti-sites 1 (Starter) / 3+ (Growth) 50 inclus 5 (Free) / 10+ (Simple)Membres d'équipe 1 (Starter) / 3 (Growth) 1 (plan de base) 1 (Simple) / 2+ (Team)Rétention des données 3-5 ans selon le plan Illimitée 30 jours (Free) / 3-5 ansOpen source Oui (Community Edition) Non NonAuto-hébergement Oui (CE, fonctionnalités réduites) Non NonWhite-label Non (sauf Enterprise) Non NonLes points saillants : Plausible est la solution la plus riche en fonctionnalités parmi les trois. L'intégration Google Search Console est un avantage significatif pour le SEO : elle permet de voir les requêtes de recherche directement dans le dashboard analytics, sans basculer vers un autre outil. Les funnels multi-étapes (plan Business) la rapprochent des outils plus avancés. Et le fait d'être open source rassure les organisations qui veulent auditer le code. Fathom se distingue par sa politique de rétention illimitée et l'inclusion de 50 sites dès le plan de base. Pour un freelance ou une agence gérant de nombreux sites à faible trafic, c'est un avantage économique réel. L'infrastructure est conçue pour le volume : ils affirment gérer des sites à un milliard de pageviews par mois. Simple Analytics mise tout sur la simplicité et la confidentialité absolue. Leur fonctionnalité « Mini Websites » permet de voir les pages exactes qui ont référencé votre site (par exemple, un tweet spécifique), ce que les autres solutions n'offrent pas. Leur outil d'IA intégré permet d'interroger ses analytics en langage naturel. Poids du script et impact sur la performance Pour un site web, chaque kilooctet de JavaScript ajouté affecte le temps de chargement et les Core Web Vitals. C'est un critère à ne pas négliger, en particulier si le SEO est une priorité.Solution Poids du script Impact estiméPlausible < 1 KB NégligeableFathom ~2 KB NégligeableSimple Analytics ~6 KB Très faiblePirsch < 1 KB (ou intégration serveur) Négligeable à nulGoogle Analytics (GA4) ~45 KB Mesurable (LCP, FID)Toutes les solutions du comparatif ont un impact négligeable sur la performance, surtout comparé à GA4. L'avantage revient à Plausible et Pirsch, dont les scripts sont les plus légers. Pirsch offre en plus une intégration côté serveur (via API ou SDK), qui élimine complètement le JavaScript côté client. Pour comprendre en détail pourquoi le poids du script analytics compte pour le SEO, consultez notre article : Mythe : Google Analytics est nécessaire pour le SEO. Quel outil pour quel profil ? Plutôt que de désigner un vainqueur, voici un guide de décision par situation concrète. Vous êtes un développeur indie ou un maker avec un SaaS Vous gérez un ou deux projets, le trafic est modéré (< 100k pageviews/mois), et vous voulez un outil qui s'installe en 30 secondes. Meilleur choix : Plausible (Starter à 9 $/mois) pour le meilleur rapport qualité-prix au premier palier, l'open source et l'intégration Search Console. Alternative : Pirsch (6 $/mois) si le budget est très serré, ou Umami (gratuit) si vous êtes à l'aise avec l'auto-hébergement. Vous êtes un freelance ou une agence qui gère 10-30 sites clients Le volume par site est faible, mais le nombre de sites est élevé. Vous avez besoin de dashboards séparés et d'un reporting simple. Meilleur choix : Fathom (15 $/mois, 50 sites inclus). Aucun concurrent n'inclut autant de sites dans le plan de base. La rétention illimitée vous évite de perdre l'historique des clients. Alternative : Pirsch qui offre aussi 50 domaines dès le premier plan. Vous êtes une PME avec des obligations strictes de conformité (DPO, registre des traitements) La question n'est pas le prix mais la démonstration de conformité auprès de votre DPO ou de votre autorité de contrôle. Meilleur choix : Simple Analytics, pour l'argument « zéro donnée personnelle ». C'est la position la plus facile à défendre dans un registre des traitements. Alternative : Plausible, dont l'hébergement 100 % européen sur infrastructure européenne (pas AWS) renforce le dossier de souveraineté. Vous êtes une organisation qui a besoin de funnels, d'e-commerce tracking ou d'analyses avancées Vous dépassez les besoins d'un dashboard minimaliste. Vous avez besoin de suivre des parcours de conversion multi-étapes. Meilleur choix : Plausible (plan Business). C'est la seule solution du comparatif qui propose des funnels avancés et le suivi des revenus e-commerce, tout en restant dans le paradigme privacy-first. Pour une vue plus large incluant GA4 et Matomo, consultez notre comparatif général : Google Analytics, Matomo et les analytics frugales : guide pour choisir en 2026. Le coût total : au-delà du prix affiché Le prix mensuel n'est qu'une partie de l'équation. Voici les coûts cachés (ou évités) à intégrer dans votre calcul. Coûts évités par rapport à GA4 : pas de formation nécessaire (GA4 requiert souvent des jours de formation), pas de consultant pour la configuration, pas de Consent Management Platform à maintenir si vous êtes éligible à l'exemption CNIL, pas de risque juridique lié aux transferts de données vers les États-Unis. Coût de migration : Plausible et Fathom permettent d'importer l'historique Google Analytics. Simple Analytics ne le permet pas. Si la continuité historique est importante pour vous, c'est un critère à considérer. Coût de l'auto-hébergement (Plausible CE, Umami) : gratuit en licence, mais comptez le temps de maintenance, les mises à jour, et le coût du serveur (environ 5 à 20 €/mois pour un VPS selon le volume). Et la Community Edition de Plausible n'inclut pas toutes les fonctionnalités du cloud (funnels, e-commerce, Sites API). Pour approfondir la question du coût réel des analytics, notre article sur la data obésité éclaire les conséquences économiques de la sur-collecte : Data obésité : pourquoi votre PME n'a pas besoin de Big Data. Tableau récapitulatif finalCritère Plausible Fathom Simple Analytics PirschPrix d'entrée 9 $/mois 15 $/mois Gratuit (limité) 6 $/moisVolume d'entrée 10k pvs 100k pvs Illimité (Free) 10k pvsSites inclus 1-10+ 50 5-20+ 50Localisation données UE (Hetzner) UE (AWS Francfort) Pays-Bas AllemagneEntité juridique Estonie (UE) Canada Pays-Bas (UE) Allemagne (UE)Hash d'IP Oui (quotidien) Oui Non OuiOpen source Oui (CE) Non Non Oui (partiellement)Rétention 3-5 ans Illimitée 30 j - 5 ans Non préciséeImport GA4 Oui Oui Non OuiFunnels Oui (Business) Non Non Oui (basique)Intégration GSC Oui Non Non OuiScript < 1 KB ~2 KB ~6 KB < 1 KBFAQ Plausible, Fathom ou Simple Analytics : lequel est le moins cher ? Cela dépend du volume. Pour moins de 10 000 pageviews par mois, Pirsch est le moins cher (6 $/mois). Parmi les trois solutions principales, Plausible est la plus accessible à petit volume (9 $/mois pour 10k pvs). À 100 000 pageviews, Plausible et Fathom se retrouvent autour de 15 $/mois. Au-delà, Plausible reste généralement moins cher, mais avec des fonctionnalités réparties entre plusieurs plans (Starter, Growth, Business). Est-ce que Plausible est vraiment conforme RGPD sans bandeau cookie ? Plausible est conçu pour fonctionner sans cookies. Leur méthode d'identification utilise un hash d'IP renouvelé quotidiennement, sans stockage de l'adresse brute. Selon les critères de la CNIL pour l'exemption de consentement, cette approche est recevable si elle est strictement limitée à la mesure d'audience et qu'aucun recoupement avec d'autres traitements n'est effectué. Toutefois, le caractère « donnée personnelle » du hash d'IP fait l'objet de débats juridiques. La prudence recommande de consulter votre DPO et de documenter votre analyse dans votre registre des traitements. Fathom est-il adapté aux agences qui gèrent de nombreux clients ? Oui, c'est l'un de ses points forts. Fathom inclut jusqu'à 50 sites dans chaque plan, avec des dashboards séparés. La rétention illimitée des données et les rapports email automatisés en font un outil bien adapté à la gestion multi-clients. En revanche, Fathom ne propose pas de white-label ni de gestion de permissions par utilisateur sur le plan standard. Quelle est la différence entre Plausible Cloud et Plausible Community Edition ? Plausible Cloud est le service hébergé et géré par l'équipe Plausible (à partir de 9 $/mois). Plausible Community Edition (CE) est la version open source, auto-hébergeable gratuitement. Mais la CE ne contient pas toutes les fonctionnalités du cloud : les funnels marketing, le suivi des revenus e-commerce et l'API Sites en sont absents. La CE convient aux développeurs qui veulent un analytics basique sur leur propre serveur. Existe-t-il des solutions encore moins chères que ces trois-là ? Oui. Umami est entièrement gratuit en auto-hébergement (open source, licence MIT). Pirsch démarre à 6 $/mois. Et pour les très petits sites, Simple Analytics propose un plan gratuit avec 30 jours de rétention. Au-delà de ces options, il faut aussi considérer que le « moins cher » n'est pas toujours le plus économique : la simplicité d'installation, la fiabilité de l'infrastructure et la durabilité de l'entreprise ont une valeur. Un outil qui disparaît ou qui bloque votre dashboard en cas de dépassement vous coûte plus cher qu'un abonnement légèrement supérieur.Dernière mise à jour : février 2026. Les prix et fonctionnalités sont vérifiés sur les sites officiels des solutions. Cet article sera mis à jour au minimum tous les six mois.

Le mythe tenace : a-t-on besoin de Google Analytics pour faire du SEO ?

C'est la première question qu'on nous pose lorsqu'on parle d'alternatives à Google Analytics : "Mais si j'enlève le script Google de mon site, est-ce que Google va me punir ? Est-ce que je vais perdre mes positions ?" La réponse courte est : Non. La réponse longue est que vous confondez probablement deux outils aux rôles très différents et que, paradoxalement, retirer Google Analytics pourrait même améliorer votre référencement. Voici pourquoi, sources à l'appui.1. La confusion fondamentale : Analytics ≠ Search Console Il existe deux outils majeurs dans l'écosystème Google pour les propriétaires de sites web. Beaucoup de gens les mélangent, ce qui entretient le mythe. Google Search Console (GSC) : votre interlocuteur avec Google C'est l'outil de dialogue avec le moteur de recherche. Il vous dit :Comment Google voit votre site (indexation, erreurs de crawl). Sur quels mots-clés vous apparaissez dans les résultats. Combien de clics et d'impressions vous obtenez. Si votre site a des problèmes techniques (mobile, Core Web Vitals).Celui-ci est indispensable pour le SEO. C'est un outil gratuit, léger (aucun script à installer sur votre site), et c'est la seule source fiable de données sur votre positionnement réel dans Google. Bonne nouvelle : la Search Console fonctionne indépendamment de Google Analytics. Vous pouvez utiliser l'un sans l'autre. Google Analytics (GA4) : un observateur du comportement sur site GA4 observe ce que font les visiteurs une fois qu'ils sont arrivés sur votre site. Il ne sert pas à améliorer votre classement dans Google. Son rôle est de mesurer l'engagement, les parcours, les conversions des informations utiles pour le marketing, mais qui n'ont pas d'impact sur l'algorithme de recherche.2. Google l'a confirmé : Analytics n'est pas un facteur de classement Ce n'est pas une supposition. Google l'a dit explicitement, à plusieurs reprises. John Mueller, Search Advocate chez Google (l'un des porte-paroles officiels de l'équipe Search), a déclaré clairement que l'utilisation de Google Analytics n'est pas un facteur de classement (ranking factor). Il a répondu à cette question sur Twitter/X et lors de sessions Google Search Central, confirmant que Google Search et Google Analytics sont des produits séparés et que l'un n'influence pas l'autre. → Source : Google Search Central – Ranking factors FAQ Gary Illyes, également analyste chez Google Search, a renforcé ce point en expliquant que le moteur de recherche n'utilise pas les données de Google Analytics pour le classement, notamment parce que tous les sites ne l'installent pas et que cela créerait un biais injuste. Autrement dit : supprimer le script Google Analytics de votre site n'envoie aucun "signal négatif" à Google. Le moteur de recherche ne sait pas (et ne se soucie pas de savoir) quel outil d'analytics vous utilisez.3. Le paradoxe : GA4 peut freiner votre SEO C'est contre-intuitif, mais le script de Google Analytics peut activement nuire à votre référencement. Voici comment. 3.1 Le poids du script Google (le moteur de recherche) favorise les sites rapides. Les Core Web Vitals un ensemble de métriques de performance web sont un facteur de classement confirmé depuis 2021. Or, le script de Google Analytics 4 n'est pas léger. Le tag gtag.js charge plusieurs bibliothèques JavaScript pour le suivi publicitaire, le consentement, et la collecte de données avancée. Le poids total peut atteindre 45 KB ou plus (compressé), auxquels s'ajoutent les requêtes réseau vers les serveurs de collecte. À titre de comparaison, voici le poids typique des scripts d'analytics concurrents :Solution Poids du script (compressé) Rapport vs GA4GA4 (gtag.js) ~45 KB RéférenceMatomo ~20 KB 2× plus légerSimple Analytics ~6 KB 7× plus légerFathom ~2 KB 22× plus légerPlausible ~1 KB 45× plus légerPirsch <1 KB 50× plus légerUne étude de Bejamas a mesuré l'impact concret des scripts tiers sur les performances web et montré que les scripts d'analytics figurent parmi les plus lourds en termes de temps de blocage du thread principal (Total Blocking Time, un des Core Web Vitals). → Source : Bejamas – How Popular Scripts Slow Down Your Website 3.2 L'impact concret sur les Core Web Vitals Quand un script lourd se charge, il impacte trois métriques clés :LCP (Largest Contentful Paint) : le temps avant que le contenu principal soit visible. Un script lourd retarde le rendu. INP (Interaction to Next Paint) : la réactivité aux clics. Un script qui monopolise le thread principal dégrade l'interactivité. CLS (Cumulative Layout Shift) : la stabilité visuelle. Certains scripts chargés tardivement provoquent des décalages visuels.Passer d'un script de 45 KB à un script de 1 KB ne transformera pas un site lent en site rapide à lui seul. Mais sur un site déjà optimisé, c'est souvent le genre de détail qui fait basculer un score Core Web Vitals du "orange" au "vert" et chaque milliseconde compte quand Google évalue la performance. → Source : Google – Core Web Vitals & Page Experience 3.3 Moins de vitesse = moins de conversions Au-delà du SEO pur, la vitesse impacte directement le taux de conversion. Google a publié des données montrant qu'au-delà de 3 secondes de chargement sur mobile, la probabilité de rebond augmente de 32 %. Chaque seconde supplémentaire aggrave la situation. → Source : Think with Google – Mobile Speed Benchmarks En résumé : en passant à un analytics léger, vous améliorez votre temps de chargement, ce qui est un vrai critère de positionnement pour Google et un facteur de conversion.4. Le Duo Gagnant pour le SEO en 2026 Pour piloter votre stratégie de référencement efficacement sans usine à gaz, voici le setup idéal : Google Search Console (Indispensable et gratuit) C'est votre source de vérité pour le SEO. Utilisez-la pour :Surveiller vos positions et vos clics dans les résultats de recherche. Identifier les mots-clés qui vous apportent du trafic (et ceux où vous progressez). Détecter les erreurs d'indexation et les problèmes techniques. Suivre l'évolution de vos Core Web Vitals.Aucun outil d'analytics, quel qu'il soit, ne peut remplacer ces données : seul Google sait sur quels mots-clés vous apparaissez réellement. Un Analytics Frugal (Pour la conversion) La Search Console vous dit d'où vient le trafic, mais elle ne vous dit pas ce qui se passe ensuite. Pour savoir si vos visiteurs SEO se transforment en clients, vous avez besoin d'un outil de mesure côté site mais il n'a pas besoin d'être complexe. Les 5 KPIs essentiels suffisent : visiteurs, sources, pages performantes, événements clés, conversions. Un analytics frugal vous donne ces réponses en quelques secondes, sans alourdir votre site. Ce que vous gagnez avec ce duoMeilleur SEO technique : un site plus rapide grâce à un script léger. Données SEO complètes : les positions (via GSC) + les conversions (via analytics frugal). Conformité simplifiée : pas de bandeau cookies si votre analytics respecte les critères d'exemption CNIL. Gain de temps : deux interfaces simples au lieu d'une usine à gaz.5. Cas pratiques : qui a coupé GA4 et que s'est-il passé ? De nombreux sites ont migré de Google Analytics vers des solutions frugales sans aucun impact négatif sur leur SEO. Le blog de Plausible Analytics documente régulièrement des témoignages d'entreprises ayant fait cette transition. Le pattern est toujours le même : aucune perte de position, souvent une amélioration de la vitesse de chargement, et une simplification de la conformité RGPD. Le site Basecamp (un éditeur SaaS de renom) a publiquement adopté Plausible en remplacement de Google Analytics. Hugging Face (plateforme majeure d'IA) également. Ces entreprises n'ont pas observé de dégradation SEO bien au contraire. L'explication est logique : Google classe les sites en fonction de la qualité du contenu, de l'autorité (backlinks), de la technique (vitesse, mobile-friendly) et de l'expérience utilisateur. Aucun de ces critères ne dépend de la marque de votre compteur de visites.Conclusion : coupez le cordon sans crainte N'ayez pas peur de supprimer Google Analytics. Votre positionnement sur Google dépend de la qualité de votre contenu et de la vitesse de votre site, pas de la marque de votre outil de mesure. Au contraire : alléger votre site en remplaçant un script lourd par un script frugal est souvent le meilleur cadeau que vous puissiez faire à votre SEO. Vous gagnez en performance, en conformité, et en clarté tout en conservant les données qui comptent vraiment grâce au duo Search Console + analytics frugal. Le vrai risque n'est pas de quitter GA4. C'est de continuer à piloter à l'aveugle parce que votre outil est trop compliqué pour être utilisé.FAQ : SEO et Google Analytics Google pénalise-t-il un site qui n'utilise pas Google Analytics ? Non. Google a confirmé à plusieurs reprises que l'utilisation de Google Analytics n'est pas un facteur de classement. Le moteur de recherche évalue la qualité du contenu, la technique (vitesse, mobile), l'autorité (liens entrants) et l'expérience utilisateur pas la marque de l'outil de mesure installé. La Search Console suffit-elle pour le SEO ? Pour le suivi des performances SEO (positions, clics, impressions, erreurs techniques), oui. La Search Console est l'outil indispensable et irremplaçable. Pour aller plus loin (mesurer les conversions, comprendre le comportement après l'arrivée sur le site), un analytics complémentaire est utile mais il n'a pas besoin d'être GA4. Quel est l'impact réel d'un script analytics lourd sur le SEO ? Le script de GA4 pèse environ 45 KB compressé. Les solutions frugales pèsent entre 1 et 6 KB. Cette différence impacte les Core Web Vitals (LCP, INP), qui sont un facteur de classement confirmé par Google depuis 2021. Sur un site déjà optimisé, passer d'un script lourd à un script léger peut suffire à améliorer les scores de performance. Puis-je utiliser la Search Console sans Google Analytics ? Oui, absolument. Les deux outils fonctionnent indépendamment. Vous pouvez connecter la Search Console à certaines solutions frugales (Plausible et Pirsch proposent cette intégration) pour voir vos données SEO directement dans votre dashboard analytics. Si GA4 n'aide pas le SEO, à quoi sert-il alors ? GA4 est un outil de mesure du comportement utilisateur et d'attribution marketing. Il est conçu pour les équipes qui ont besoin de funnels de conversion détaillés, de cohortes comportementales, et d'intégrations avec l'écosystème publicitaire Google (Google Ads). Pour le SEO pur, il n'apporte rien que la Search Console ne fournisse déjà et son poids peut même desservir votre référencement.

- 05 Jan, 2026

Arrêtez d'envoyer des rapports PDF que vos clients ne lisent pas

C'est la fin du mois. Pour tout freelance ou chef de projet en agence, c'est l'heure de la corvée : le reporting mensuel. On exporte des PDF depuis Google Analytics, on fait des captures d'écran, on ajoute trois commentaires dans un email, et on envoie le tout. Temps passé : 2 à 4 heures. La réalité ? Votre client ouvre le PDF, regarde la première courbe, ne comprend pas pourquoi le "Taux d'engagement" a baissé de 0,4 %, et referme le document. Vous avez perdu une demi-journée. Et il n'a pas perçu la valeur de votre travail.1. Le problème du reporting "Comptable" Pourquoi ça ne marche pas L'erreur classique est de vouloir prouver qu'on a travaillé en montrant beaucoup de chiffres. "Regardez, il y a 45 pages de graphiques, donc j'ai bien bossé." Mais votre client (souvent un dirigeant de TPE/PME) ne vous paie pas pour des graphiques. Il vous paie pour des résultats et de la tranquillité d'esprit. Lui envoyer un rapport complexe revient à lui renvoyer le problème à la figure. Il ne sait pas quoi en faire, et il finit par douter de votre utilité. Ce que disent les études Selon une enquête HubSpot sur les pratiques des agences marketing, le reporting est systématiquement cité parmi les tâches les plus chronophages et les moins valorisées par les clients. Le paradoxe est cruel : plus vous passez de temps sur le rapport, moins il est lu parce que sa longueur même décourage la lecture. Une étude de Databox auprès de professionnels du marketing montre que la majorité des clients souhaitent un reporting court et orienté résultats, pas un audit exhaustif. Les clients les plus satisfaits sont ceux qui reçoivent un résumé de 5 à 10 indicateurs maximum, accompagné d'une recommandation claire. → Sources : HubSpot – State of Marketing Report, Databox – Reporting Best Practices2. La méthode : Moins de Data, Plus d'Histoire Pour qu'un rapport soit lu, compris et apprécié, il doit raconter une histoire simple en 4 actes. C'est du Data Storytelling appliqué au reporting client. Acte 1 Le "One-Liner" (La Météo du mois) Commencez votre email de reporting par une seule phrase qui résume le mois. Votre client doit pouvoir comprendre la tendance sans ouvrir aucune pièce jointe.Mauvais : "Voici les statistiques du mois de janvier." Bon : "Mois record sur le trafic (+20 %), mais légère baisse des contacts qualifiés on sait pourquoi et on corrige."Cette phrase est le test ultime. Si vous ne pouvez pas résumer le mois en une ligne, c'est que vous n'avez pas encore trouvé l'insight (l'idée forte). Retournez dans les chiffres. Acte 2 Les 3 KPIs Macro (Le Tableau de bord) Ne mettez pas tout. Rappelez uniquement les objectifs définis au début du contrat, et montrez l'avancement. Trois indicateurs suffisent dans la grande majorité des cas. Pour un site vitrine ou un blog, ce sont typiquement les 5 KPIs essentiels mais dans le reporting client, condensez encore : trafic global, nombre de leads/ventes, et la métrique "étoile" du mois (celle qui a le plus bougé, en bien ou en mal). Présentez ces chiffres avec la comparaison au mois précédent et à l'objectif. Un tableau de 3 lignes vaut mieux qu'un PDF de 40 pages.Indicateur Objectif Mois dernier Ce mois TendanceVisiteurs uniques 5 000 4 200 5 100 ✅ +21 %Contacts formulaire 30 28 22 ⚠️ -21 %Coût par lead (si Ads) < 15 € 12 € 18 € ❌ +50 %Acte 3 "Ce que nous avons fait" → "Ce que cela a produit" C'est ici que vous vendez votre travail mais en le reliant aux résultats, pas en listant des tâches.Mauvais : "Nous avons publié 4 articles de blog, optimisé 3 pages, et ajusté les mots-clés." Bon : "L'article sur le RGPD (publié le 15) a généré 450 visites qualifiées depuis LinkedIn → 8 contacts formulaire. Les 3 pages optimisées sont passées de la page 3 à la page 1 sur leurs mots-clés cibles."L'idée est de systématiquement lier l'action à l'impact. Si une action n'a pas encore produit de résultat mesurable, dites-le honnêtement ("impact attendu dans 4-6 semaines, on surveille"). Acte 4 Le plan pour le mois prochain C'est le plus important et le plus souvent oublié. Un reporting ne doit pas seulement regarder le rétroviseur. Il doit vendre la suite."Vu que le trafic LinkedIn augmente (+40 % en 2 mois), le mois prochain nous allons doubler la fréquence des posts." "La baisse des contacts vient d'un formulaire trop long (5 champs au lieu de 3). On simplifie la semaine prochaine."Ce dernier acte rassure le client sur deux choses : vous comprenez ce qui se passe, et vous avez un plan. C'est ce qui fidélise bien plus qu'un PDF de 45 pages.3. Avant / Après : le même mois, deux reportings Pour rendre la méthode concrète, voici la même période présentée de deux façons. ❌ Le reporting "Comptable" (Ce que vous faites peut-être)Email de 3 lignes ("Voici le rapport mensuel, n'hésitez pas si vous avez des questions"). PDF joint de 38 pages exporté depuis GA4. Graphiques non commentés : taux de rebond, durée de session, flux d'utilisateurs, rapports démographiques. Temps de production : 3h30. Probabilité que le client le lise en entier : ~5 %. Perception client : "Je ne comprends pas, mais je suppose que ça va."✅ Le reporting "Frugal" (La méthode en 4 actes)Email structuré de 15 lignes maximum (One-Liner + 3 KPIs + Actions/Résultats + Plan). Un tableau de 3-5 lignes intégré dans l'email (pas de pièce jointe). Optionnel : un lien vers un dashboard partagé en temps réel (Plausible, Fathom, etc. le permettent). Temps de production : 45 minutes. Probabilité que le client le lise : ~80 %. Perception client : "Mon prestataire a les choses en main. Il comprend mon business."Le gain est triple : vous passez 3 fois moins de temps, le client comprend 10 fois mieux, et votre valeur perçue augmente. C'est la définition d'un cercle vertueux.4. L'outil conditionne le format Il y a une raison pour laquelle le reporting "Comptable" persiste : c'est l'outil qui le produit. Google Analytics génère des rapports PDF de dizaines de pages parce qu'il a des dizaines de rapports. Quand votre outil est une usine à gaz, votre reporting hérite de cette complexité. L'inverse est vrai aussi. Quand votre outil de mesure affiche un dashboard qui tient sur un écran visiteurs, sources, top pages, conversions votre reporting en découle naturellement. Vous n'exportez plus 40 graphiques : vous faites une capture d'écran et vous la commentez. C'est l'un des arguments les plus forts pour passer à un analytics frugal quand on gère plusieurs clients : le temps de reporting baisse mécaniquement parce qu'il n'y a rien à "filtrer". L'outil ne montre que l'essentiel. Certaines solutions (Plausible, Fathom) proposent même des dashboards partageables en lecture seule : vous donnez un lien à votre client, il peut consulter ses stats quand il veut, sans vous déranger. Le reporting mensuel devient alors un email de commentaire stratégique, pas un export de données.5. Le cas du multi-clients Pour une agence ou un freelance qui gère 10, 20, 30 sites, le problème du reporting est multiplié. Passer 3 heures par client = 30 à 90 heures par mois de reporting pur. C'est intenable. La solution passe par trois leviers :Standardiser le format. Utilisez le même template en 4 actes pour tous vos clients. Seuls les chiffres changent. Choisir un outil multi-sites. Les solutions frugales permettent généralement de gérer tous vos clients depuis une seule interface, avec un dashboard par site. Le comparatif des solutions détaille les limites de sites par offre. Automatiser le partage. Plutôt que d'exporter des PDF, partagez un lien vers le dashboard en temps réel et envoyez un email de commentaire stratégique. Le client a accès aux chiffres 24/7, et votre valeur ajoutée est dans l'analyse, pas dans l'extraction.Conclusion : Vendez de l'intelligence, pas des tableaux Un bon outil d'analytics ne devrait pas vous servir à générer des PDF automatiques. Il devrait vous servir à trouver l'insight l'idée forte, la tendance, l'opportunité que vous allez partager à votre client en 3 phrases. Si votre outil est trop compliqué, vous passez votre temps à chercher la donnée. S'il est simple, vous passez votre temps à l'analyser. C'est cette analyse qui justifie votre tarif pas le nombre de pages du PDF. En 2026, la valeur d'une agence n'est plus dans l'extraction de la donnée. Elle est dans sa traduction en décisions business. Et pour ça, il faut commencer par mesurer uniquement ce qui compte.FAQ : Reporting client Combien de temps consacrer au reporting mensuel par client ? Avec la méthode en 4 actes, comptez 30 à 60 minutes par client. Si vous dépassez régulièrement 2 heures, c'est un signal que votre outil de mesure est trop complexe ou que vous n'avez pas standardisé votre format. L'objectif est que le temps passé à analyser soit supérieur au temps passé à extraire. Faut-il automatiser entièrement les rapports ? Non. L'automatisation complète (exports programmés, emails automatiques) produit du bruit. Votre client reçoit un PDF sans contexte et ne sait pas quoi en faire. L'idéal est un modèle hybride : les données sont accessibles automatiquement (dashboard partagé), et votre valeur ajoutée est le commentaire stratégique mensuel que vous rédigez vous-même. Quels KPIs montrer à un client e-commerce ? Pour un e-commerce, les 3 KPIs macro sont : le chiffre d'affaires généré par le site, le taux de conversion (visiteurs → acheteurs), et le coût d'acquisition client (si publicité). Tout le reste est du détail opérationnel que vous gérez en interne. Votre client veut savoir combien le site a rapporté, pas combien de personnes ont cliqué sur le bouton "Ajouter au panier". Mon client insiste pour avoir un rapport GA4 détaillé. Que faire ? Éduquez-le progressivement. Envoyez-lui le format frugal en 4 actes en plus du PDF qu'il demande. Au bout de 2-3 mois, demandez-lui lequel il lit réellement. Dans 90 % des cas, il admettra qu'il ne lit que votre email et vous pourrez alors supprimer le PDF.